Roon Labs trafia pod skrzydła Harman International (Samsung vibe, tak, tak koreański czebol jest właścicielem HI). Wczoraj gruchnęła informacja na forum użytkowników wielokrotnie opisywanego na łamach HDO front-endu audio. Obiecałem, że coś skrobnę nt. Roona i cóż, tak się złożyło, że pojawił się dodatkowy impuls. Właściciele sprzedali, wielki koncern nabył, pojawiają się pytania co to oznacza dla Roon Labs, ale nade wszystko dla użytkowników. Jakiś rok z okładem pisałem niezbyt przychylnie o oprogramowaniu, które wyraźnie złapało zadyszkę – wolne, błędy, niestabilne, no kicha. Minął rok i muszę donieść, że nastąpiła… właśnie przed momentem… fundamentalna zmiana na PLUS. Roon uwolnił się od przyciężkawej aplikacji wszystko-mającej na rzecz tadam tadam leciutkiego softu serwerowego. ŻEGNAJ ROON CORE, WITAJ ROON SERWER. To kapitalna wiadomość dla nas, użytkowników, bo soft – jako się rzekło – po dodawaniu licznych nowych funkcjonalności (mobilny ARC, przebudowa DSP, rozbudowa info o muzie i samego tworzenia bibliotek) po prostu stał się niestrawny, pochłaniając cenne zasoby nawet szybkiej maszyny zawiadującej front-endem (hist. Core).

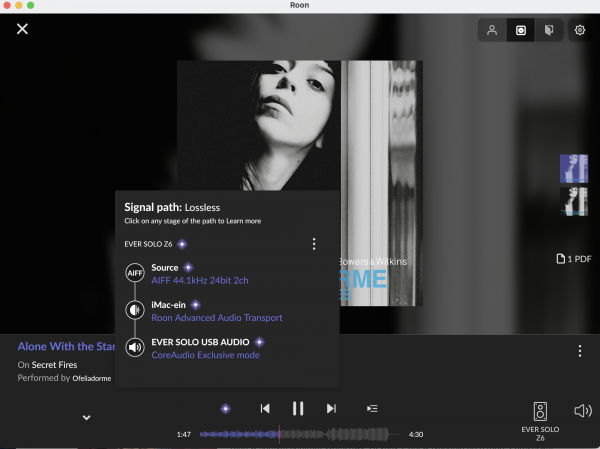

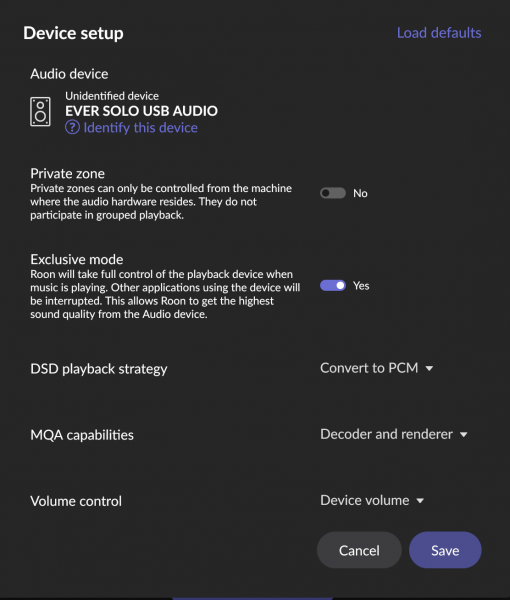

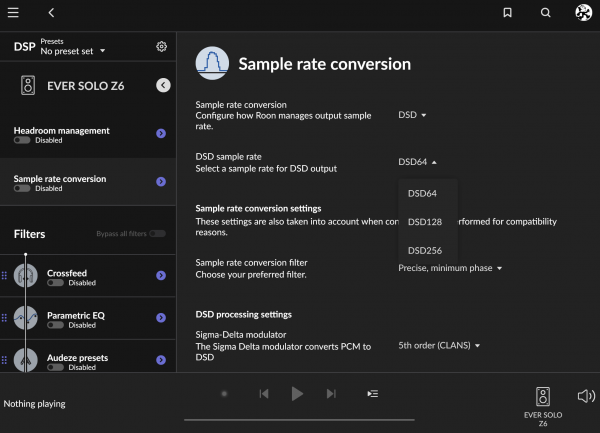

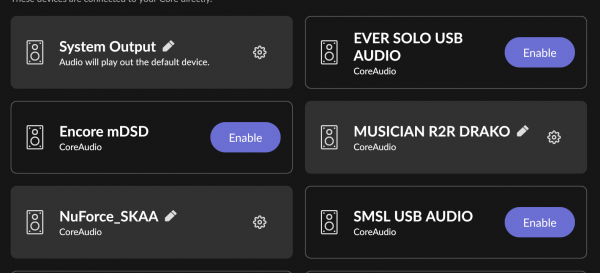

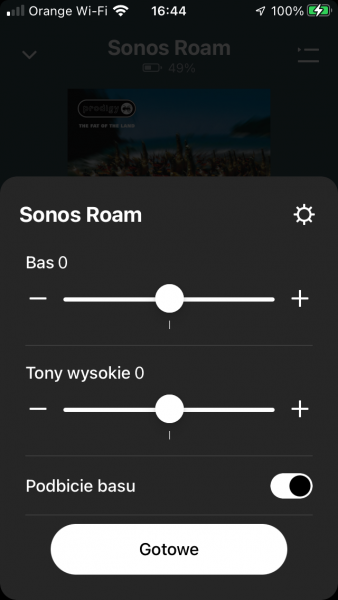

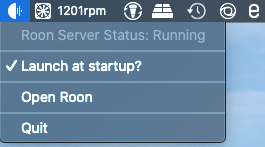

Jestem pod ogromnym wrażeniem! Ten wariant jest wprowadzany tym razem stopniowo, załapałem się dwa tygodnie temu, inni mogli cieszyć się wcześniej, są tacy którzy jeszcze czekają. To fundamentalna zmiana, wcześniej znana garstce userów korzystających z modułu serwer (dedykowane maszyny Nucleus, własne rozwiązania serwerowe), a teraz to podstawa funkcjonowania oprogramowania. WRESZCIE! Z ociężałego, mamy super szybkie, super sprawne, super stabilne, naprawdę niebo a ziemia. Na maszynie z głównym kodem nie ma teraz całego, obciążającego UI/UX, jest tylko skromna ikonka na pasku zadań i tyle. Oczywiście wszystko działa jak do tej pory w sensie rozbudowane strefy, liczne end-pointy (jak ktoś ma na bogato i korzysta), działające DSP w tle (przeszło znaczącą metamorfozę, to wg. mnie najlepszy moduł programowalnego processingu audio przygotowany na potrzeby domowego użytku), ogromna baza informacji o muzyce, integracja usług / serwisów, no i wspomniany Roon na zewnątrz tj. ARC.

Chciałem napisać tuż po premierze, wcześniej informując Czytelników o trwających pracach nad umobilnieniem Roona. Dobrze, że się wstrzymałem. Działało to mocno tak sobie, teraz, po zmianie całej architektury sotware wreszcie można z tego sensownie korzystać. Szczególną wartością jest integracja z wektroniką (od w(v)ehicle tj. samochodowe systemy cyfro-info-media) w pojazdach. To pozwala na umilanie sobie czasu jazdy z naszymi ulubionymi artystami, składnikami, nawigowanie po tagach, po propozycjach, w ramach świetnie działającego fokusowania, po zbiorach, przepastnych (jak ktoś ma, znaczy nie tylko strumieniuje z usług) audio bibliotekach. Także mamy i Remote i pełny UI/UX na dowolnym komputerze, handheldzie, dalej streamerze ze wsparciem dla Roona… nic tu się nie zmieniło odnośnie funkcjonalności, a jest szybciej, stabilniej, no zdecydowanie lepiej!

To, co jest tu dodatkową wartością to otwarcie szerokie na moduły (plug-iny), rozszerzenia, które developerzy wreszcie dostrzegli (bo też Roon stał się dość popularny, na pewno w środowisku tzw. audiofilskim bardzo nawet) i ruszyła brać koderów do pisania. Sam korzystam z rozszerzenia dla sterowania via MS Dial (tu gała głośności na poziomie front-endu czyli dla wszystkiego podpiętego wspólnie, pierwotnie rzecz pod ekrany Surface, do nawigowania dla kreatywnych) czy interfejsu dla przystawki telewizyjnej Apple TV. Zasadniczo możliwości są tutaj nieskończenie, nieskończone i takie rzeczy jak choćby Dirac, czy rozbudowane moduły korekcji innych firm tylko czekają…

Sumując o samym sofcie, naprawdę jest dobrze, wreszcie nareszcie przysiedli i zrobili to, co należało już od dawna zrobić. Z ciężarnej krowy do niedawna, Roon znowu śmiga i używa się go z przyjemnością. Byłem bliski pojechania developerowi za popsucie softu, chciałem serio się wypisać (płacę roczny sub, bo uważam że należy docenić pracę załogi), miałem dość ciągłego restartowania, powolnej pracy i ogólnie coraz gorszego, jak to mówią Anglosasi „user experience”. Także jak komuś jeszcze nie wpadło 2.0.25 to zapewniam – niebo a ziemia, znowu polubicie Roona.

Niepozorne, małe, a tak wiele zmienia…

Dobra, o sofcie było, o pozytywach, a jak ocenić to co na wstępie stoi? Znaczy sprzedaż i wejście do wielkiego molocha jakim jest obecnie grupa Harmana? Dla właścicieli i całego obecnego stuff-u to pewnie duże merkantylne pozytywy. Cóż to biznes, ludzie zarabiają, ktoś zaproponował worek kasy i poszło. Na pewno rozszerzy to bazę producencką, możliwe że otworzy pole do ekspansji na poziomie elektroniki użytkowej (Samsung), głównie obstawiałbym głośniki smart i kinodomowe okolice. No ok, choć budzi to pewne kontrowersje i pytania, ale to tylko takie tam dywagacje. A konkrety? No konkretnie to niezależy dev staje się częścią korporacji i traci ten przywilej bycia niezależnym właśnie. Nie musi, ale może oznaczać to duże zmiany. I to takie zasadnicze dla użytkowników (także ofc samych pracowników Roon Labs). Doświadczenia z tego poletka są różne, nie chcę bić w kasandryczne tony, może będą robić swoje i tyle, ale może być też tak, że moneteryzacja będzie NUMER JEDEN i wszystko inne nie będzie miało znaczenia.

Trudno bawić się we wróżkę, mogę tylko z doświadczenia napisać (także posługując się pewnym przykładem z branży), że to szansa, ale też zagrożenie. Szansa na dokapitalizowanie, otwarcie na nowe (usługi, bo tu były pytania, czy Tidal tylko, czy niszowy Qobuz to dobre dla Roona i wystarczające), wypłynięcie na szerokie wody elektroniki użytkowej, nie tylko tej HiFi-owej… Oczywiście od razu pojawia się pytanie, czy Roon nie jest po prostu produktem pod potrzeby wybranego, a nie masowego klienta. Mam wątpliwości, choć ARC pokazuje, że można żenić i nie przesądzam.

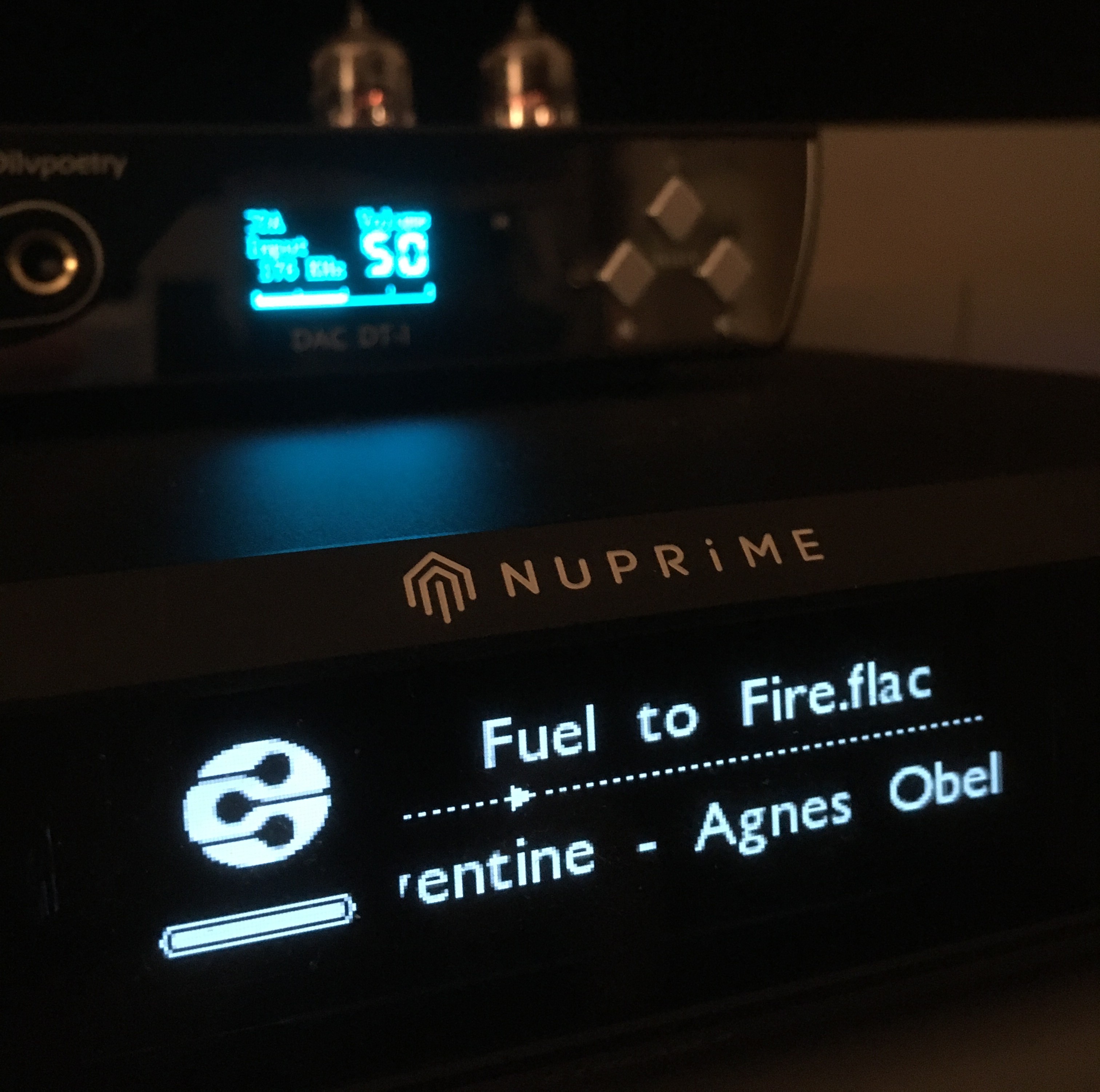

Przykład historyczny to Slim Devices, Squeezebox-y i przejęcie przez wielkiego Logitecha. To też była szansa. Świetny w latach 2000, jedyny taki, będący protoplastą wszystkich sensownych rozwiązań cyfrowego audio opartego na strumieniowaniu z sieci, trafił pod skrzydła wielkiej korpo. Co się stało później, wszyscy wiemy. Szwajcarzy (no teraz to już Dolna Krzemowa) rozwijali, rozwijali i zwinęli interes. Squeezebox umarł. Sqeezebox zmartwychwstał, stał się niezależny, ale też tylko dzięki wybitnie prężnej, dużej grupie użytkowników. Soft stał się społecznościowy, rozwijany niezależnie i LMS jest do dzisiaj używany, aktualizowany, trwa. Ba jest implementowany w sprzęcie, głównie DIY, ale nie tylko, stanowiąc ciekawy przykład „życia po życiu”, właśnie z powodów wyżej opisanych. Sam do dzisiaj korzystam z SB Touch (2 z EDO robią za nadal znakomite streamery, czasami z LMS, jednak głównie w ramach opisywanego front-endu Roon-a), mam też końcówkę PC na Daphile i wraz z bardzo fajnym kodem do zarządzania mobilnego mimo „śmierci” to nadal służy i służyć będzie.

No dobrze, to co w takim razie z Roonem, co oznacza te przejęcie? Wróżką nie jestem, czuję że o ile Harman Int. będzie po prostu zainteresowany implementacją i popularyzacją front-endu (dobrze), jako wielki właściciel takich marek jak JBL, AKG, Arcam itd itp zrobi pożytek należyty z tego kodu, tak obawy i to spore mam odnośnie Koreańczyków. Samsung to wielka niewiadoma i o ile w ogóle zainteresuje się i będzie wpływał to może to być dla Roon-a mocno niekorzystne, doprowadzić do zmian jakich byśmy sobie (userzy) nie życzyli. Od spraw oczywistych jak subskrybcja lifetime (utrzymana? Zmieniona na jakąś wersję tylko dożywotnio?) i w ogóle całej polityki koszto-cenowej pod nowym właścicielem, po rozwój softu – utrzymanie tempa aktualizacji, dodawania nowego, integrowania szeroko hardware audio itd itp.

Mówimy o konkrencji na rynku. Sooloos (Meridian) czyli pierwotny team i coś, od czego się zaczęła przygoda pt. Roon Labs to była autonomia i niezależność od branży. Teraz to już jest historia, przeszłość, teraz Roon to część rynku audio, konkretnych producentów, marek, firm, a nade wszystko wspomnianego Samsunga, który jest właścicielem. Roon uważany był (trochę na wyrost i trochę bez sensu) jako jałbkolubny soft, taki co to faworyzuje jabco (na początku tak było, bo Android nie był wspierany, czy też musiał czekać na lepsze wsparcie). Od dawna jednak twórcom przyświecało „nieważne czego używasz” możesz cieszyć się front-endem i czy PC, czy Mac, czy Win, czy Linux (bardzo mocno promowany na marginesie przez koderów Roon Labs), czy Apple, czy Google, czy Sonos (różne zintegrowane hardware ww. firm z front-endem)… proszę bardzo, korzystaj użytkowniku z tego, co tam stoi na półeczce, biureczku.

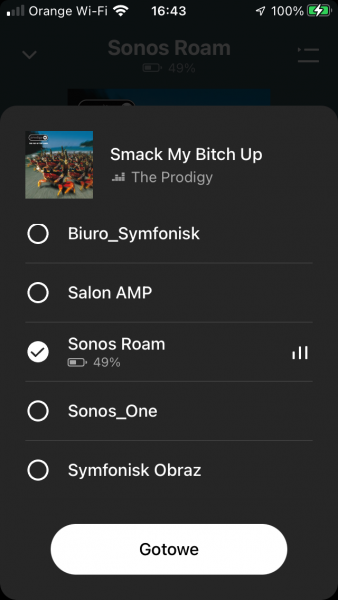

Właśnie Sonos. Kto wie, może właśnie Sonos będzie największym „przegranym” tego dealu? Apple jest za duże, by odcinać AirPlay (taaaa, Samsung, ale przecież we wszystkim kopiuje, wspiera AP w swojej elektronice, także…), ale już Sonos mesh można, bo czemu by nie? I choć główną zaletą (po to się go kupuje) Roona jest własny protokół RAAT, w pełni wykorzystujący moc tego software (zawiadywanie, info, DSP itd itp) to twórcom przyświecała piękna myśl o maksymalnej kompatybilności z tym, co w domach gra. Także odnośnie rzeczy niekoniecznie HiFiowych, jak choćby Chromecast (Audio i Video), wspomniany LMS, ale też high-endowych jak własne rozwiązanie Linn-a, czy przystępniejszych jak NADowski BluOS (tu mówimy o pełnej integracji) itd itp. to wszystko wspierane jest pod Roonem. Czy to zostanie zachowane i dalej będzie wspierane, rozwijane?

Roon Ready, Roon Tested – wszystkie te elementy ekosystemu Roon Labs / Roon zostaną wystawione na próbę… czy tylko wybrane rozwiązania będą miały pełny dostęp, lepsze możliwości, gwarancję działania pod nowym właścicielstwem, w nowych okolicznościach przyrody? Zobaczymy. Na pewno możemy spodziewać się (bo w przeciwnym razie po co by nabywali?) ekspansji na marki Harmana certyfikacji Roona, integracji ichnich rozwiązań strefowych (sporo tego w portfolio), możliwe że jakiegoś ukłonu w stronę samsungowych usług (asystent…? brrrr). Mam nadzieję, że społeczność, że otwartość developera na uwagi i w ogóle na współtworzenie software przy współudziale użytkowników nie pójdzie do kibla. I nie, dzisiaj powtórka z LMS może się zwyczajnie nie udać. Kiedyś było to możliwe, bo rynek był bardzo niewielki, ten segment znaczy to były dopiero początki i Logitech po prostu oddał zasoby w ręce zwykłych ludzi. Wtedy to zadziałało, dzisiaj to już wg. mnie nie przejdzie i dlatego mam pewne obawy jw. Sam dev mówi: CHCEMY WIĘCEJ. Oby to więcej nie było kosztem jakości i kosztem tworzenia czegoś dla ludzi, a nie tylko działania w imię zysku. Nie mam problemu z płaceniem programistom za ich ciężką pracę, ale na pewno będę miał problem z płaceniem za decyzje zarządu, który widzi tylko słupki.

Obiecywałem (obiecanki cacanki), że będzie o sprzęcie. Będzie. Niespodzianki czekają, mam parę rzeczy nietypowych i nieopisywanych w testach gdziekolwiek~bądź, także spokojnie będzie obok tego, co opisuje branża – nowe, jeszcze nieodkryte, a wywracające stoliczek. Także stay tuned!