Autor: Antoni Woźniak

|

Kategoria: Artykuły, Audio, Handheldy, Slider, Streaming, Słuchawki, Technologie

|

| Źródło:

HD-Opinie.pl

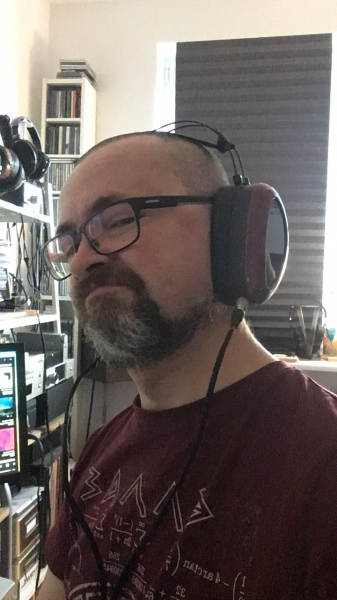

Nie było taryfy ulgowej. Słuchałem długo, bardzo długo, w różnych okolicznościach przyrody, sprawdzając jak się te nauszniki sprawdzają w „boju”. Chciałem – po pierwsze – sprawdzić ergonomię. Wygoda tudzież jej brak w przypadku tak oryginalnej konstrukcji (przypominam – połączenie dokanałowego wsadu, z wokół-usznymi muszlami) to rzecz do tej pory niewystępująca, według mnie nie bez przyczyny, w słuchawkowym wszechświecie. Po drugie obadać wpływ działania indywidualnego profilowania (pomiar naszego aparatu słuchu przez słuchawki) na to, co słyszymy i jak słyszymy. Tak, tutaj w grę wchodzą pierwsze wrażenia z odsłuchu, SQ, ale nie skupiałem się na własnych odczuciach (podoba się, nie podoba się) tylko szkiełkoocznej, czyszkiełkousznej analizie & porównaniu tego nowatorskiego systemu z opcją bez dostosowania („neutral”). Po trzecie wyszły wszystkie plusy i minusy sterowania dotykowego w wydaniu NuraPhone, mogłem po tych paru tygodniach wyrobić sobie jednoznaczną opinię na temat. Po czwarte oceniłem jak się sprawuje moduł – stabilność transmisji, parowanie, przełączanie między urządzeniami. Po piąte sprawdziłem granie po kablu (cyfrowo z kompem). Wreszcie po szóste sprawdziłem i oceniłem w warunkach „on the go” jak się zachowują w trakcie ulewy, gradobicia i kokluszu  znaczy się, czy deszczyk nie wadzi, a jak wadzi w czym wadzi, jak było długo słuchane, a było, to czy tzw. TeslaFlow (wentylowanie) się sprawdza, nie robi się sauna, czy wręcz przeciwnie znaczy robi się (moje Senki Wireless OvE to koszmar w cieplejsze dni, koszmar) oraz – na deser – FrontRow… jak się ma tektoniczne wzbudzanie basiora do szlachetnej sztuki budowania kulturalnego masowania na dole. Ekhmmm. Dobra, zainteresowani Future-Fi w wariancie słuchawkowym? No to jedziemy…

znaczy się, czy deszczyk nie wadzi, a jak wadzi w czym wadzi, jak było długo słuchane, a było, to czy tzw. TeslaFlow (wentylowanie) się sprawdza, nie robi się sauna, czy wręcz przeciwnie znaczy robi się (moje Senki Wireless OvE to koszmar w cieplejsze dni, koszmar) oraz – na deser – FrontRow… jak się ma tektoniczne wzbudzanie basiora do szlachetnej sztuki budowania kulturalnego masowania na dole. Ekhmmm. Dobra, zainteresowani Future-Fi w wariancie słuchawkowym? No to jedziemy…

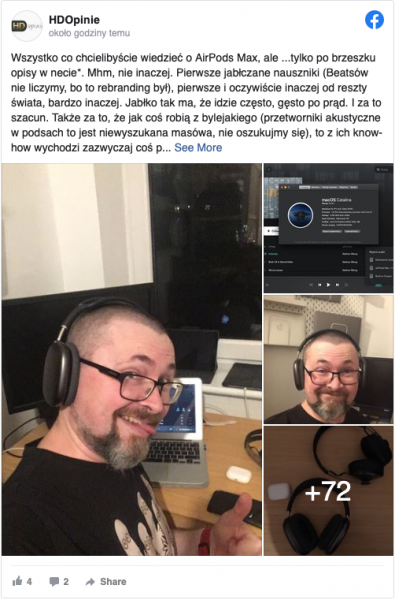

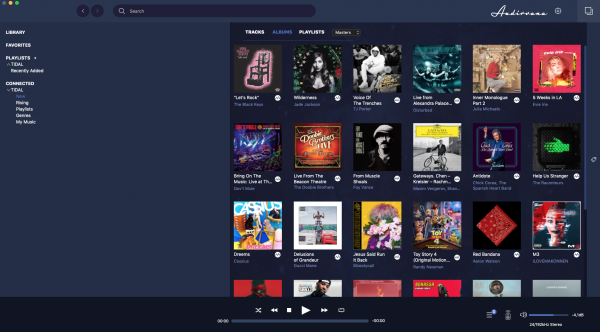

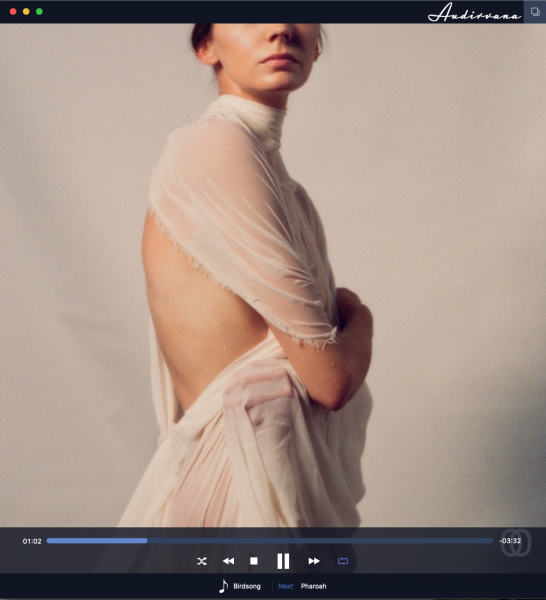

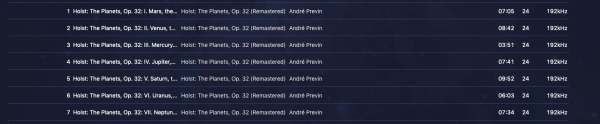

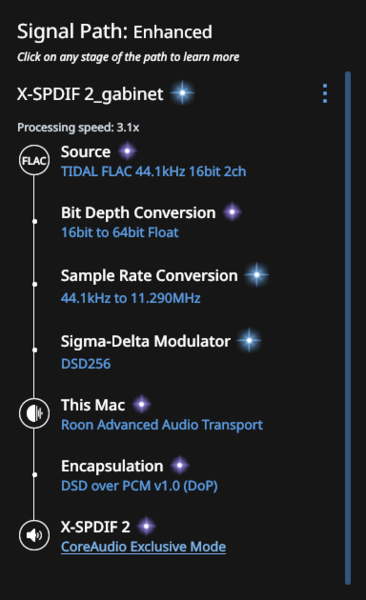

Grane z kabla USB na makówie. Cymes. Naprawdę szkoda, że firma nie zrobiła aplikacji na kompy…

Może zrobi?

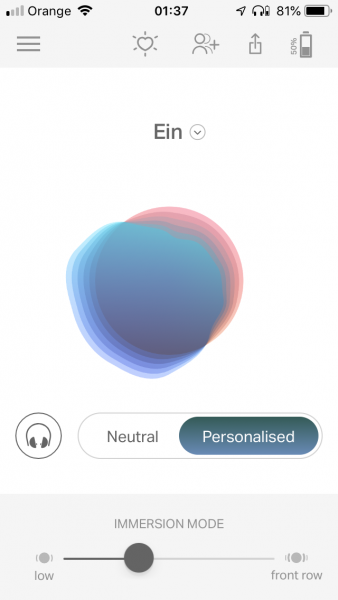

A tak rzeczywiście słyszę, na stronie opisują (mniej więcej) jak to czytać…

Co się podobało? (rozwinięte w stosunku do zajawki, końcowe spostrzeżenia, całościowa ocena)

- słuchawki przylegają jak przyklejone do głowy, świetnie izolują (ANC dodatkowo robi robotę, o czym poniżej jeszcze będzie), płynny mechanizm dopasowania precyzyjnie nam je układa na łbie. Jest opór, także nie wyrobi się to (mechanizm), tu nie ma żadnych zastrzeżeń. Dokanałowy patent dodatkowo stabilizuje i utrzymuje nauszniki w określonej pozycji (polecam pałąk umieścić w okolicach czubka głowy). Pałąk to w ogóle mocny punkt konstrukcji – nie męczy (żadnego ucisku na czubku, czy w okolicach styku nie doświadczamy), wew. materiał nie wywołuje potliwości (widać, że ktoś tu projektował całościowo). Deszcz niestraszny, ale (patrz „co wymaga dopracowania”). Nie ma uczucia pieczenia na czubku głowy.

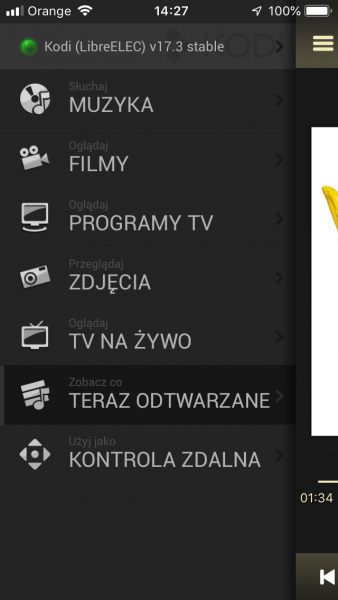

- aplikacja daje radę, cały proces ustawiania słuchawek przebiega sprawnie. To pierwsze słuchawki na rynku, które łączą się z… serwerem producenta, gdzie dane na temat konfiguracji zapisywane są zdalnie. Uprzedzam, w offline też to działa, ale nie do końca. Chcesz rozpocząć przygodę, LTE/3G być musi (no sieć, dostęp). Dlaczego -tak?- będzie w rozwinięciu recenzji, powiem tylko tyle, że profilowanie stanowi progres, o czym w następnym myślniku…

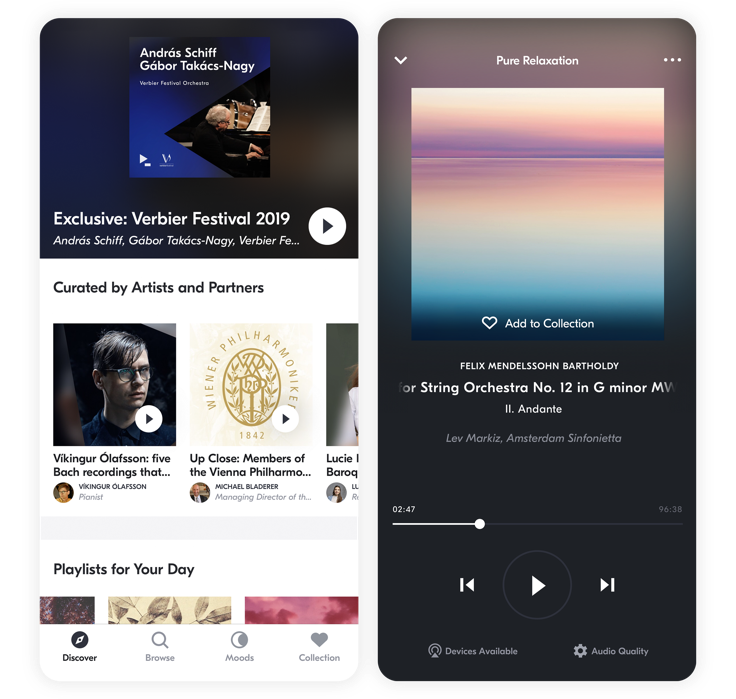

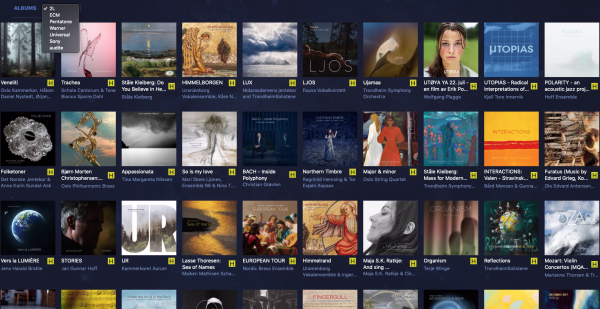

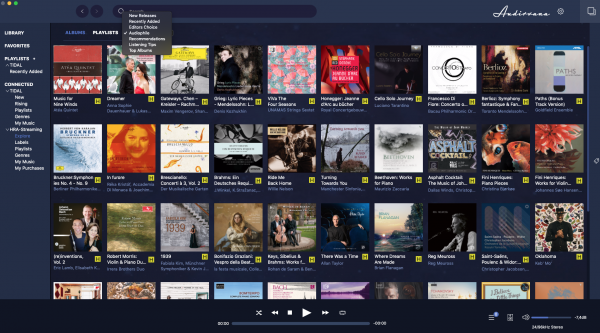

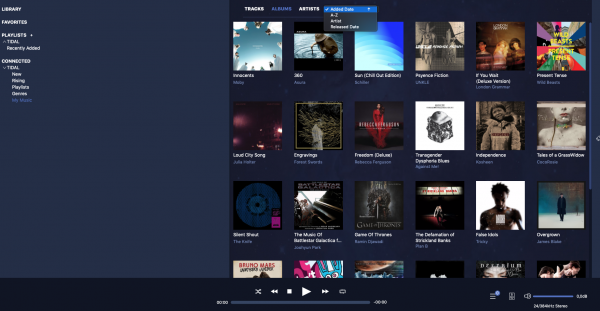

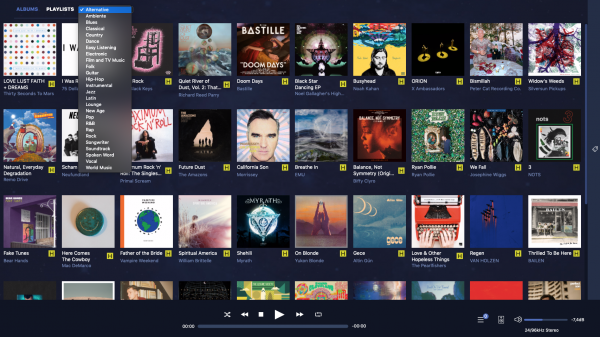

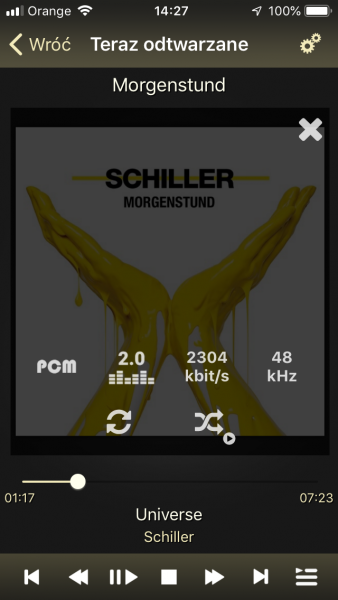

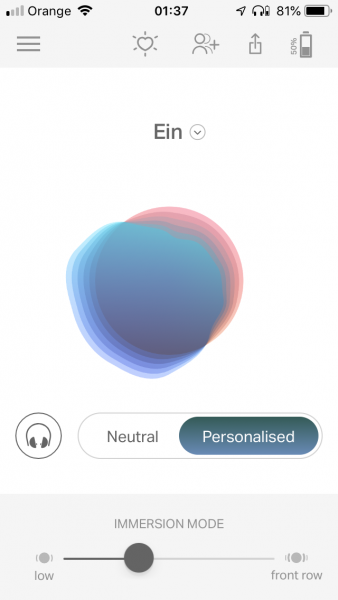

- nurasound. Profilowanie, pomiar, osobisty, pomierzony, skalibrowany układ pod nasze ucho. Tak, możecie sobie to szybko przetestować, sprawdzić, bo genialną sprawą jest możliwość szybkiego przełączania (profil/neutralne granie) w sterowaniu dotykowym lub via apka (działa w tle, nie przerywa się wtedy odtwarzanie z dowolnego softwarowego playera). To jest przyszłość. Potęga kodu, pomiar, dopasowanie, korekcja. To się dzieje w świecie dużego, stacjonarnego audio, to zaczyna się dziać w słuchawkowym światku. True-Fi, Reference, profile pod Audeze w Roonie… tak, moi drodzy, software będzie miał, ma coraz więcej do powiedzenia odnośnie finalnej, wynikowej jakości dźwięku. Mój profil na obrazku. Warto zapisać sobie w notatniku (tak też zrobiłem), można przechowywać na serwerach producenta, można sobie ten profil zarchiwizować jw. w dowolnym miejscu. To robi. Wpływ na to co słyszymy ogromny. Najpierw wydaje się, że to pod rozrywkowe doznania, że w porównaniu do neutralnego profilu, jest za bardzo „hej do przodu”, ale im dalej w las tym wyraźniej zaczynamy dostrzegać, że słyszymy wyraźniej, że detale, które umykały, których nie było, albo ledwo były słyszalne, one są, że jednak to inaczej, pełniej, bliżej tego, co w materiale siedzi. Jest tu pewien myk, tym mykiem jest FrontRow, ale da się nad tym panować w pełni, bo to konfigurowalne jest. Można zatem zrobić sobie karykaturę na własne życzenie, można. Jednak z samym nurasound nie ma to za wiele, nie, nie ma to nic wspólnego. Mówią „music in full colour”. Tak, chodzi o barwę, o poszczególne pasma, ale chodzi także jw. o coś więcej. Zamiast zewnętrznego DSP mamy coś zintegrowanego, coś – co pozwala na dopasowanie. Dokładne. W testowanych słuchawkach był zachowany profil pracownika (?) dystrybutora. Włączyłem. Dobra, jeżeli tak inaczej odbieramy muzykę, w tak odmienny sposób kształtuje się nasza percepcja to… wiecie, co to oznacza? No właśnie. Dla mnie to poważne wyzwanie „teologiczno-dogmatyczne”, bo to przecież podstawy. System bada nasz aparat słuchu, robi to powtarzalnie (sprawdziłem, wyniki zbliżone) i robi to zasadniczo przekonująco. W większości wypadków (wiele osób obadałem) efekt był pozytywny, grało lepiej, dla użytkownika z wyraźnym progresem w stosunku do ustawienia neutralnego.

- bardzo wytrzymała (FullMetalJacket) konstrukcja. Pałąk jest nie do zdarcia, podobnie muszle, grube, mocarne pady, gumowy wsad IEMowy… okablowanie, wpuszczony głęboko w obudowę muszli port. Będę służyć lata. Metal, precyzyjne spasowanie. Do tego dbałość o szczegóły (lubimy i cenimy), czytaj: świetnej jakości nosidełko i bardzo elastyczny (wygodny) przewód (pewnie inne, niestety nie w komplecie, a dodatkowo płatne, kabelki też takie jak ten do pudła dodawany).

- sterowanie dotykowe zazwyczaj się nie sprawdza. Zazwyczaj jest to jakiś patent obejmujący całą muszlę, który w praktyce w negatywny sposób wpływa na użytkowanie. A jak jest tutaj? Otóż, inaczej, choć nadal z problemami. Inaczej, bo producent zaaplikował dotykowe powierzchnie na niewielkich mocowaniach muszli z pałąkiem. Elegancko, ale jeszcze nie idealnie (choć da się to imo poprawić w aktualizacjach oprogramowania). Elegancko, bo zamiast mazać po całej muszli, mamy definiowane przez nas w aplikacji (bardzo fajne) możliwości pełnej konfiguracji tego sterowania. Oparte jest to na pojedynczym, albo podwójnym tapnięciu, mamy zatem możliwość wywołania 4 komend, przy czym funkcjonalnie to dublowanie (bo włączamy coś i wyłączamy coś). Trochę mało, przydałoby się więcej (nie obejmuje to wszystkich chcianych funkcjonalności, szczególnie że możemy regulować tu takie rzeczy jak działanie DSP). Działa to pewnie, nie jest przekombinowane, także tu plus. Reszta poniżej (co należy dopracować).

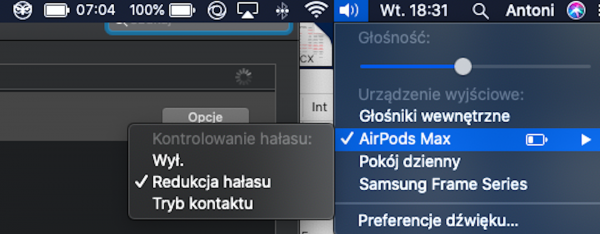

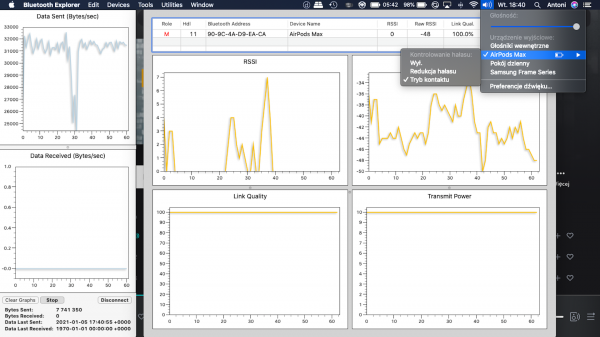

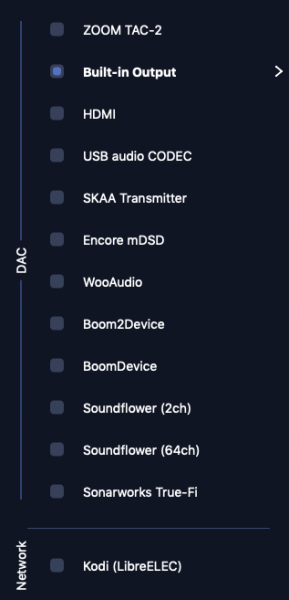

- cyfrowo z kompem jest znakomicie. Naprawdę znakomicie. Z jednym „ale”. Nie ma aplikacji pod komputer, a więc wcześniej gdy słuchawki sparowane są (a mogą być TYLKO Z JEDNYM źródłem) ustawiamy sposób pracy. Jak wszystko włączymy (DSP aktywne, ANC aktywne) to tak będzie grało. I nie zmienimy tego, bo dotykowe sterowanie słuchawek po kablu nie działa. Kolejna rzecz do poprawki w aktualizacjach oprogramowania. Jak już jednak podepniemy (też w celu podładowania) to ho, ho, ho. Wewnętrzny DAC robi robotę (jest 16/44-48 tylko), bardzo pozytywne odczucia z odsłuchu. Kabel mógłby być w związku z tym dłuższy, ale dzięki elastyczności jest wygodnie, byle nie za daleko (bo się nie da). Słuchamy i zapominamy o bożym świecie. Oczywiście w makówach będzie działał aptX (via BT Explorer), niestety nie aptX HD (który jest tu także obsługiwany), bo Apple generalnie wiele standardów olewa, choć ostatnio tak jakby się to zmienia (w nowym OS będzie nawet dźwięk obiektowy, no wow). Także kabel zadaje kłam niektórym opiniom, że te słuchawki nie potrafią grać dobrze bez ficzerów. Owszem, potrafią, tyle że nie w trybie BT (bez ficzerów), o czym poniżej jeszcze będzie…

- deszcz nie straszny, znaczy odporne na działanie wilgoci są, choć trzeba mieć w pamięci, że po pierwsze producent milczy na ten temat, po drugie wentylacja (otwory wokół muszli, na styku padów / obudowy) to potencjalne źródło problemów. Tak czy inaczej nie zauważyłem żadnego negatywnego wpływu, a parę razy lało jak jasna cholera. Samo wentylowanie sprawdza się bardzo dobrze, szczególnie w porównaniu jw. z moimi dotychczasowymi bezprzewodowymi nausznikami to niebo a ziemia. Uszy nie pocą się aż tak jak w innych zamkniętych konstrukcjach, są wentylowane, a dodatkowo to wentylowanie nie ma to negatywnego wpływu na separację od czynników zewnętrznych, bo efektywne ANC, bo patent z dokanałową konstrukcją.

- FrontRow. W Berlinie śmiałem się z tego, na IFA się śmiałem, bo miałem na uszach masaż i to taki, że po parunastu sekundach ściągnąłem Skulle (bo tej firmy tj. Skullcandy słuchawki wywołały u mnie wesołość) z wyrazem WTF na twarzy. Tam też dało się regulować, przy czym działało to tak, że albo basu nie było, albo bas był, ale tylko bas. Tu jest inaczej, bo owszem może być karykatura, ale aktywna komora (bo tak od środka prezentują się musze), która pracuje przez cały czas (gumowa, wyprofilowana wykładzina), jak membrana w głośniku (przy czym nie jest to część samego przetwornika!), faktycznie konfiguruje nam ten zakres, w miarę sensownie, nie idealnie, ale na pewno w sposób akceptowalny, a nie jw. idiotycznie bezużyteczny. Te słuchawki mogą być ciekawe dla bass-headów, ale też mogą być opcją dla osób, które wolą niskie trzymane (ściśle) w ryzach. Mamy wybór.

- jak zdejmiemy to przestają działać, jak założymy wznawiają, witając się i podając od razu ile procent i czy się ze źródłem skomunikowały (choć to ostatnie nie zawsze)

- adaptacja. Serio. Po tygodniu ból mija, choć – zaznaczam – to indywidualna sprawa i może się zdarzyć, że akurat Wam nie minie i będzie bolało

Co wymaga dopracowania?

- pojawiają się problemy w komunikacji z PC/Mac. Nie udało się ustawić pod macOS 12.14.5, na starszej makówie z HighSierra poszło bez problemów. Na pewno powinni dać software konfigurujący pracę także w wersji komputerowej. Bardzo tego brakuje!

- ANC działa sprawnie, ale nie idealnie. System da się ustawić pod okoliczności (można słuchać i jednocześnie rozmawiać, tudzież nie wpaść pod samochód), to funkcjonuje bardzo dobrze, szkoda że opcji gradacji działania nie ma, bo fajnie by było mieć nad tym większą kontrolę. Do wprowadzenia. Tak czy inaczej tryb Social użyteczny, ale do udoskonalenia…

- precyzja działania dotyku zbyt czuła. Muśnięcie i już. A przypadkowo, szczególnie w takim, wypustkowym, położeniu wywołać coś to nie problem. A problem właśnie jest. Także może jakiś czas reakcji, może sama czułość… to powinno też dać się ustawić programowo (idealnie, gdyby taka opcja pojawiła się w aplikacji konfigurującej pracę słuchawek). Poza tym w deszczu przestaje działać (no wiadomo, tego nie da się raczej obejść), trzeba nurkować po źródło, telefon. Gdyby tak jeszcze wprowadzić opcję 3 tapnięć i rozszerzyć możliwości sterowania to byłoby pikobello. Aktualizacja?

A co zgrzyta i jest (wg. autora) od czapy?

- choćby nie wiem jak się starał, to IEMowy wsad męczy, po paru godzinach czuć ból. Wyraźnie czuć. To efekt nacisku, a może precyzyjniej, ucisku okolic kanału usznego. Wsad jest mocno osadzony i dociśnięty do ucha. Nie ma tu przypadku, to intencjonalne, bo połączone z profilowaniem, z pomiarem naszego ucha i dopasowaniem pracy układu, z nurasound. Coś za coś niestety. Dźwięk zostaje dostarczony najbardziej bezstratnie do ucha, ale też mamy problem z ergonomią, z wygodą. Ciśnie. Także ten SoftTouch niestety nie jest soft, tylko hard. Silikon (nazywany przeze mnie wcześniej „gumą”) jest przyjemny w dotyku, fakt, nie poci się skóra (to też ma wpływ, znaczy materiał ma), pewnie nie alergizuje (jak ktoś ma tego typu problemy), wszystko to prawda, ale całościowo będzie bolało po dłuższym czasie użytkowania. Ciekawostka, jak odwrócimy słuchawki (da się je nałożyć tylko w jeden, określony sposób, tj. portem ładująco-grającym po prawo) to jest… wygodniej. Tyle, że wtedy doki nie wchodzą idealnie w uszy i po włączeniu muzy jedyne co słychać to dudnienie. To oczywiście mocno indywidualna sprawa. Jak poinformował mnie dystrybutor, jestem jedną z nielicznych osób, które zwróciły uwagę na ten problem. Na dole macie krótki filmik, który opisuje rzecz, dodatkowo zamieściłem informację o wkładach, jakie są w komplecie (w demówce ich nie było). Aha, i jeszcze jedno, nie ma problemu z wypożyczeniem słuchawek, przetestowaniem ich na miejscu.

- nie są w żaden sposób składane, nie da się ich pomniejszyć do transportu (stąd duże nosidło). Być może konstruktorom zależało na wyborze – nie składać, zrobić panzer i wybrać długowieczność, kosztem łatwości przenoszenia słuchawek. Szanuję, oceniam nawet pozytywnie w kontekście jw. ale mobilne słuchawki to składaki i to się generalnie sprawdza użytkowo. Tu się tak nie da, tak ten typ ma.

- parowanie ręczne i odparowywanie. Obawiam się, że tego akurat softwareowo nie zrobią, bo jakby moduł dawał radę (może któryś z ficzerów uniemożliwia taką opcję?) to by było na starcie i po kolejnych aktualizacjach. Niestety. Choć autoparowanie jest uskuteczniane, to przy większej liczbie urządzeń, musimy nurkować do ustawień. Dodatkowo trzeba pamiętać o wyłączeniu pary BT i BT LE. Dopiero po odłączeniu można korzystać z innego, wcześniej sparowanego sprzętu. Nie ma dwóch równocześnie, z kompami czasami długo trwa proces nawiązania łączności (z mobilnym raczej bez zwłoki). Funkcja przywracania też potrafi się pogubić.

- jakość rozmów jest rozczarowująca. Nie wiem, czy mogą coś z tym zrobić, ale tu naprawdę przydałaby się konkretna poprawa. Często „jak przez butelkę”, charczy, nie jest czysto, bywa że nawiązane połączenie jest, a nic nie słyszymy. Trzeba wtedy zmienić w telefonie odbiór na słuchawkę w fonie, innym urządzeniu i powtórnie wybrać. Także nasza rozmowa bywa trudno słyszalna. Słabe to.

Takie reklamy w Londynie. W wielu miejscach. Nura na uszach i na plakatach

Podsumowując

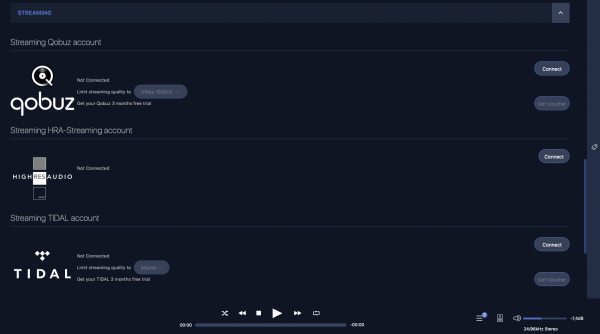

Przetestowane słuchawki to rzecz oryginalna, awangardowa, zdecydowanie warta uwzględnienia. To przyszłość. Systemy DSP (kod) pozwalające w dowolnych uwarunkowaniach uzyskać optymalne brzmienie. Takie rzeczy jak Dirac, True-Fi, Reference (Sonarworks) i wiele innych robią różnicę zasadniczą i wraz z rozwojem, z integracją (w sprzęcie vide NAD, miniDSP, Arcam i wielu innych) stanowić będą standardowe wyposażenie przyszłych klamotów. Nie dziwi zatem, że w przypadku słuchawek obserwujemy dokładnie to samo. Profile Audeze w ramach firmowego software oraz plug-in’y dla kombajnów (Roon, JRiver…) – jesteśmy na początku drogi, fascynującej drogi. W przypadku Nura dostajemy nie tylko dobrze wykonane, intrygująco & nowatorsko zaprojektowane (kabel oraz oprofilowany tryb bezprzewodowy, bez profilu via BT gra to słabo) nausznice, dostajemy przede wszystkim „know-how” z innowacyjnym mechanizmem pomiaru dna ucha, oparty na super czułych mikrofonach, z zaawansowanym kodem dopasującym pracę przetworników do naszej anatomii.

To jest clou. To robi różnicę i stanowi najistotniejszy element, kluczowy w tym produkcie. Reszta jest ważna, ale dopiero to robi różnicę. Powiem więcej – gdyby nie to, specyficzne połączenie zamkniętej muszli z IEMowym wsadem uznałbym za ciekawostkę, mało praktyczną, no problematyczną, dyskusyjną ciekawostkę. Owszem, daje to pewne korzyści (głównie w zakresie izolacji), ale też dla wielu osób, wybierających nausznice właśnie dlatego, że IEMy są dla nich nieakceptowalne. W tym wypadku musi być właśnie tak, bo wymaga tego opracowany system pomiarowy. Ucho musi być izolowane i musi być dźwięk pomiarowy ukierunkowany bardzo precyzyjnie inaczej całość nie ma sensu. Zdarzało się, że pomiar mimo paru prób nie kończył się sukcesem, osoba badana nie mogła utworzyć swojego profilu. Wada? Moim zdaniem niekoniecznie, a wręcz nawet zaleta, bo dowodzi, że ten system to nie jest hokus-pokus, tylko coś realnie działającego, mającego wpływ. U jednej z osób wyszło, że ma problemy ze słuchem (lewe ucho), że budowa uszu uniemożliwia tej osobie komfortowe użytkowanie IEMów (dowolnego typu). Także pomiar wielokrotnie nieudany, w końcu zakończony ledwo co powodzeniem (bez optymalnego położenia słuchawek, badany odczuwał dyskomfort) udowodnił, że to działa – profil grał gorzej niż ustawienie neutralne.

Także jestem na tak, mimo pewnych wątpliwości. To coś nowego, coś innego, coś co musi dopiero udowodnić swoje kompetencje. Czekam na innych, nie tylko w tym sensie, że innych producentów słuchawek BT z zaawansowanymi systemami DSP, ale także tych, którzy sprzedają klasyczne słuchawki, bez ficzerów, a widząc co się dzieje (Audeze) chce wycisnąć ze swoich nauszników maksimum. Gotowe profile to dopiero początek… plug-iny, które dodatkowo będą w czasie rzeczywistym dostosowywać działanie EQ, współpracując z zaawansowanymi DSP w oprogramowaniu odtwarzającym.

W opcji on-the-go niestety po pewnym czasie uszy odmówiły współpracy. Bolało. Jako zapas robiły RHA i cóż… przydały się jak widać. Ale minęło. Po tygodniu zaadaptowałem się i mimo najszczerszych chęci udowodnienia, że jednak boli, nie bolało. Zaadaptowałem się.

PS. BTW to projekt kickstarterowy, swego czasu sporo o różnych wynalazkach z tego serwisu było u nas (grafeny, lewitujące klamoty, psychomanipulacja  )

)

Poniżej MEGA_GALERIA z opisami oraz rozwinięcie recenzji, o specyfikacji, technologii i dźwięku (tak, o tym też  …

…

» Czytaj dalej

![]()

![]() Także ta umowna, a jednak niezbyt trudna do uchwycenia, różnica w przypadku opisanego w niniejszym wpisie setupu wyraźnie się zaciera. I to jest piękne. Zaciera się z plikiem, ale jeszcze bardziej zaciera się wg. mnie z kompaktem. Właściwie, mógłbym powiedzieć tak: komputer czy raczej plik był tutaj kierunkiem zmian, progresu jaki dokonywał się w SQ słuchanym za pośrednictwem I2S wraz z konwersją do sygnału 1 bitowego, a płyta finał, kropkę nad i, tego progresu uwieńczenie. Czy to dziwne? Nie bardzo. Kompakt jest z nami od bez mała 40 lat jako nośnik audio, także przebył długą, wyboistą drogę (to po pierwsze), stał się opanowanym, dojrzałym medium (właściwie to niedawno, bo wcześniejsze próby jego udoskonalania, jak wiemy, poniosły rynkową klęskę, nie przyjęły się vide SACD/DVD-A). Tylko, w sumie, co z tego, jak zwija się dzisiaj (wiele muzyki wychodzi wyłącznie w pliku, czasami dochodzi do tego winyl, ale już nie srebrny nośnik) i tego zjawiska nikt już nie odwróci. No tak, ale – na szczęście – poza tym co nowe jest całe bogactwo świata dźwięków zarejestrowanego wcześniej i nadal egzystującego na kompakcie. Co prawda, podobnie jak to się ma z czarnym krążkiem, płyta podlega przemijaniu, nie jest wieczna, ale na tyle wytrzymalsza od poprzedników, że prędzej będziemy szukać na rynku czegoś, co nam to fizyczne odtworzy (z czym coraz trudniej, jak wyżej), oczywiście pod warunkiem odpowiedniego uszanowania, dbałości o kolekcję, zbiory.

Także ta umowna, a jednak niezbyt trudna do uchwycenia, różnica w przypadku opisanego w niniejszym wpisie setupu wyraźnie się zaciera. I to jest piękne. Zaciera się z plikiem, ale jeszcze bardziej zaciera się wg. mnie z kompaktem. Właściwie, mógłbym powiedzieć tak: komputer czy raczej plik był tutaj kierunkiem zmian, progresu jaki dokonywał się w SQ słuchanym za pośrednictwem I2S wraz z konwersją do sygnału 1 bitowego, a płyta finał, kropkę nad i, tego progresu uwieńczenie. Czy to dziwne? Nie bardzo. Kompakt jest z nami od bez mała 40 lat jako nośnik audio, także przebył długą, wyboistą drogę (to po pierwsze), stał się opanowanym, dojrzałym medium (właściwie to niedawno, bo wcześniejsze próby jego udoskonalania, jak wiemy, poniosły rynkową klęskę, nie przyjęły się vide SACD/DVD-A). Tylko, w sumie, co z tego, jak zwija się dzisiaj (wiele muzyki wychodzi wyłącznie w pliku, czasami dochodzi do tego winyl, ale już nie srebrny nośnik) i tego zjawiska nikt już nie odwróci. No tak, ale – na szczęście – poza tym co nowe jest całe bogactwo świata dźwięków zarejestrowanego wcześniej i nadal egzystującego na kompakcie. Co prawda, podobnie jak to się ma z czarnym krążkiem, płyta podlega przemijaniu, nie jest wieczna, ale na tyle wytrzymalsza od poprzedników, że prędzej będziemy szukać na rynku czegoś, co nam to fizyczne odtworzy (z czym coraz trudniej, jak wyżej), oczywiście pod warunkiem odpowiedniego uszanowania, dbałości o kolekcję, zbiory.